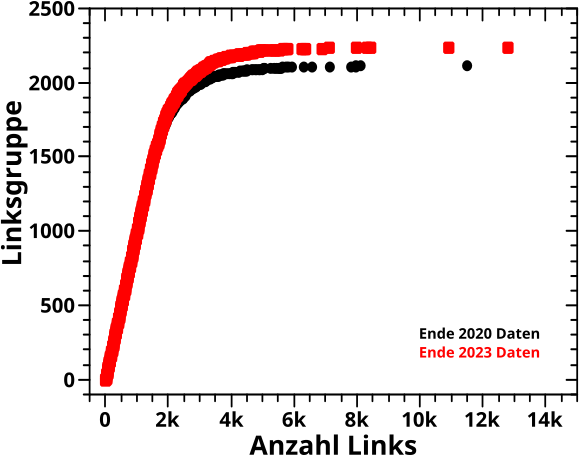

Zum Ende meines diesjaehrigen Geburtstagsbeitrags schrieb ich:

[…] [D]as Thema […] werde ich anhand eines konkreten Beispiels an anderer Stelle nochmal aufgreifen.

Da ich bisher anderweitig beschaeftigt war, liesz die Antwort auf sich warten (und mir ist bewusst, dass der Abschluss der Hormesis-Reihe schon laenger her ist und dass auch die Feinstaubreihe noch in der Luft haengt).

Das konkrete Beispiel ueber das ich heute schreibe ist eine weitere „Anwendung“ des im Geburtstagsbeitrags anhand eines (anderen) Beispiels illustrierten Prinzips. Oder anders: wieder bleibt mir das „Hab dich!“ (bzw. hier eher „du bist ja doof“) im Halse stecken, wenn ich alles gruendlich durchdenke und mein Gegenueber deswegen besser verstehe.

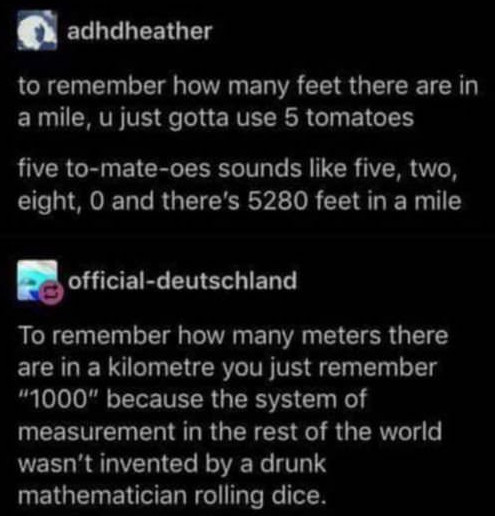

In kurz geht es um diesen alten Gag …

Geklaut von hier, ’ne echte Originalquelle gibt’s sicher nicht.

… der sich (meist) ueber (US) Amerikaner lustig macht … und frueher hab ich kraeftig mitgelacht (und mitgemacht).

Irgendwann ist mir dann aber mal aufgefallen, dass ich …

… „1 Meter“ sage, mir aber eine Schrittlaenge vorstelle, und zu Fusz gehe …

… „5 Kilometer“ sage, mir aber die Strecke zwischen Buch und Grieben vorstelle, … bzw. heute bei 4 km an einen Spaziergang um den Theisendam denke … und das automatisch mit ca. 1 Stunde spazieren gehen gleichsetze … oder 20 Minuten Fahrrad fahren … oder durchgeweichten Stoffschuhen, aber trockenen Herbstschuhen, bei leichtem Regen, …

… „500 km“ sage, mir aber die Strecke Trondheim – Oslo vorstelle, … und das automatisch mit einer unbestimmten, definitiv nicht metrischen Menge Stress gleichsetze, weil das oft Fliegen bedeutet, …

… „einmal um die halbe Welt“ sage, mir aber die Strecke Norwegen – Japan vorstelle, … *opps* nun ist ja nicht mal mehr das erste metrisch, …

… … … .oO(genug der Laengen) … … …

… „ein halber Liter“ sage, mir aber ’ne Colaflasche vorstelle, …

… „25 kg“ sage, mir aber vorstelle wie schwer ein Sack Zement ist, …

… beim kochen definitiv NICHT „14.7868 Milliliter“ sage oder denke, sondern einfach ’n Essløffel voll benutze (gerne gehaeuft), …

… weisz, dass die Strecke Erde – Sonne ungefaehr 150 Millionen Kilometer sind, das aber (fast) nie benutze sondern (fast) immer an eine Astronomischen Einheit denke, …

… ich von Milli-, Micro, Nanosekunden weisz und oft genug damit zu tun hatte (und habe), ein Tag aber trotzdem 86,400 Sekunden enthaelt.

Ich møchte damit ausdruecken, dass das metrische System zwar toll ist, wenn man was zu rechnen hat und das mit Sachen die nicht in der eigenen „Werkstatt“ (im allerweitesten Sinne) gemacht wurden vergleichen muss. Aber im Alltag verdient es nicht unbedingt die Huldigungen, die es so oft bekommt … insb. von Leuten wie mir. Sobald ich eine „alltagstaugliche“ Zahl im Zusammenhang (Laenge, Masse, Zeit) høre, stelle ich mir Mehltueten anstatt Kilogram, Colaflaschen anstatt Volumen und Stress oder Zeiteinheiten anstatt Laengen vor … und letztere kønnen sogar noch unterschiedlich sein, je nach Verkehrsmittel … oder anders: ich stelle mir alles AUSZER metrischen Einheiten in meinem Alltag vor.

Und selbst das Rechnen ist physikalisch gesehen nur in kleinen Bereichen metrisch. Ich wuerde sagen bis zu Laengen von ca. 1/2 Million Kilometer, dann faengt man eher an in Lichtsekunden zu rechnen. Ab ca. 50 Millionen Kilometern in astronomischen Einheiten, ab ca. 1 Billion Kilometern in Lichtjahren und ab ca. 1 Billiarden Kilometern in Parsec … und irgendwann ist alles so weit weg, dass man nur noch in Rotverschiebung rechnet. Keine einzige dier Einheiten ist mit den anderen Einheiten mittels einer fein durch 10 teilbaren Konstante „verbunden“. Vielmehr ist es ein buntes Kuddelmuddel an Umrechnungsfaktoren. Und alle Umrechnungsfaktoren beziehen sich auf Dinge die man sich vorstellen kann (mehr oder weniger).

Dito, bei der Zeit. Im ganz Kurzen ist alles metrisch, aber schon die Minute hat 60 Sekunden … wenigstens bleibt der Faktor auch fuer die naechste Einheit erhalten. Und dann kommt der Tag mit seinen 24 Stunden … aber das basiert ja wenigstens alles noch auf der Zahl 6 … aber die 6 ist definitiv nicht metrisch. Und dann schwankt die Anzahl der Tage im Monat … und das Jahr laeszt sich weder in eine 10-er Zaehlung noch eine 6-er Zaehlung pressen (auch der franzøsische Revolutionskalendar løste Problem nicht in Gaenze). Dennoch, wird so vieles in Jahren angegeben. Und sobald man 10 Jahre voll hat, geht es wieder mit 10-Faktoren los … wobei eine Dekade oder ein Jahrhundert ja dann doch auch wieder nicht mit der „durch 1000 teilen“ Regel zusammen passt. Und ich hab auch noch nie jemanden sagen høren: ich bin jetzt 0.044 Millenia alt … vielleicht sollte ich damit anfangen, einfach um die Leute zu verwirren … tihihi.

Die gleichen Ueberlegungen zur Masse ueberlasse ich euch, meinen lieben Leserinnen und Lesern, zur Uebung als Hausaufgabe.

Die Einheitlichkeit (!) aller Masze (und Gewichte … wie man frueher sagte, auch wenn ein „Gewicht“ ja auch nur ein Masz fuer Masse ist) ueber die Dorf- und Landesgrenzen hinweg (und ebenso wichtig: ohne Aenderungen dieser Einheitlichkeit ueber die Jahre) ist wichtiger als der Umrechnungsfaktor zwischen den verschiedenen Einheiten der verschiedenen Skalen. Es ist fein, dass dieser im metrischen System ein Faktor 1000 ist. Das macht bestimmte technische Berechnungen auf gewissen, eher limitierten Skalen (siehe oben), einfacher.

Aber wenn alle Leute einheitlich irgend ein anderes System benutzen wuerden, weil sie damit aufgewachsen sind, dann waere das in den allermeisten Faellen genauso gut. Ich brauche naemlich nie ’ne Tonne Salz beim Kochen und wenn ich mal 10 Liter Milch brauche, dann schreibe ich nicht „10 Liter Milch“ auf den Einkaufszettel sondern nur „Milch x10“ (man beachte hier, dass ich die Maszeinheit weglasse). Heutzutage muss das naemlich nicht mehr im Laden abgemessen werden und ich kann mich drauf verlassen, dass eine Tuete Milch genauso viel Fluessigkeit enthaelt wie die die daneben steht. Und ja! Es liegt an genau der Vereinheitlichung, dass ich mich drauf verlassen kann. Was fuer eine das ist, ist aber egal und in den USA wuerden es dann eben nur zwei grosze Milchflaschen werden (da fehlt dann zwar ungefaehr 1 Liter, aber bei 10 Litern kommt’s darauf dann auch nicht mehr wirklich an bzw. ist das Kuchenrezept angepasst).

Zusammengefasst bedeutet das zwei Sachen:

1.: Wer im Glashaus sitzt (und selber alles als „Døner pro Fuszballfeld“ im Geiste wahrnimmt), sollte sich nicht ueber Leute lustig machen die das direkt, also ohne Umwege (mehr oder weniger) lebensferner Maszsysteme, tun.

2.: Das macht natuerlich im obigen Bilde auch schon den Ursprungsbeitrag unnuetz. Es kuemmert mich doch ueberhaupt nicht, wie viele Fuesze in einer Meile sind. Eine Meile bedeutet doch viel eher, dass ich das nicht laufen werde, sondern in 2 Minuten (eine Zeiteinheit) mit dem Auto (eine „Arbeitseinheit“ oder „Stresseinheit“ oder „Faulheitseinheit“ wenn man auch gehen kønnte) da bin.

All das Gesagte ist natuerlich anders zu sehen, wenn ich Zucker in andere Laender verschicken oder an der internationalen Raumstation mitbauen will … aber das sind lebensferne Sachen, die mit 99.999% des Lebens der aller-aller-aller-aller-aller-allermeisten Menschen nix zu tun haben … nicht mal dann, wenn sie in ferne Laender reisen, weil man sich dort dann recht schnell auf ein anderes Messsystem einstellt. Und fuer den Rest reicht es, wenn man sich auf ein System einigt, das muss aber mitnichten das Metrische sein.

Wenn man hingegen das Leben besagter aller-aller-…-allermeisten Menschen bedenkt frage ich mich dann doch, ob das Maszsystem der USA nicht vielleicht doch besser (da lebensnaeher) ist.

Da faellt mir ein, dass ich dazu mal was zur Temperatur hatte, bei der die Experten lange Zeit meinten, dass das ueberhaupt nicht objektiv gemessen werden kann (und im Alltag tun wir das immer noch nicht … da geht’s nur um warm oder kalt bzw. darum ob die Brøtchen noch weisz oder schon angebrannt sind).

So viel Geschrieben und zum Abschluss kann ich leider nur sagen, dass mich diese Erkenntnis zum „Spielverderber“ macht. Ich lache (nicht mehr) ueber Sachen die viele andere Menschen in meinem Umkreis voll witzig finden … und dann kann ich meinen Mund nicht halten und møchte den Leuten zwar nicht ihren Spasz nehmen, ihnen aber gerne klar machen, warum es sich lohnt, sich in andere Menschen hinein zu versetzen … und sehr schnell haben die Menschen um mich herum keine Lust mehr auf, als Moralpredigten wahrgenommene, lange Monologe von mir und fangen an sich selbst zu zensieren wenn ich dabei bin und erzaehlen keine Witze mehr … und damit habe ich dann doch den ganzen Spasz verdorben … *seufz*.

So … damit das nicht so traurig endet hier ein Beispiel wie man sich-lustig-machen weglassen kann und dabei dennoch lustig bleibt:

Geklaut von hier … und ich bin zu faul um den urspruenglichen Erschaffer (bzw. Quelle) zu suchen (zumal ich ohnehin nicht denke, dass das von Erfolg gekrønt waere).

Witzig!

Ich wuensche erholsame Feiertage :) .